娤應僨乕僞偐傜偺崅師尦嬻娫傪惂尷偡傞堿娭悢悇掕庤朄偵偮偄偰

A Method for Extraction Implicit Functions which Restrict High Dimension Space from Observed Data

2011/08/24 i-horse

--abstract--

崅師尦嬻娫傪惂栺偡傞堿娭悢傪悇掕偡傞庤朄偑幚偼庡惉暘暘愅偺棤曉偟偵側偭偰偄傞偙偲傪帵偡丅

--key word--

Implicit Function, Principal Component Analysis, Kernel Principal Component Analysis

丂夋憸側偳偺崅師尦僨乕僞傪峫偊傞嵺丄偦傟傪埖偄傗偡偄傛偆側掅師尦偵埑弅偡傞庤朄偑條乆偵抦傜傟偰偄傞丅椺偊偽庡惉暘暘愅偼僨乕僞偺忣曬僄儞僩儘僺乕傪嵟戝偵偡傞傛偆側掅師尦偵埑弅偡傞庤朄偱偁傞丅傑偨夋憸偱偁傟偽DCT曄姺側偳偵傛偭偰僗僷乕僗側僨乕僞偵曄姺偟偨屻埑弅僙儞僔儞僌偺庤朄偵傛傝埑弅媦傃嵞惗偑壜擻偱偁傞丅

丂僨乕僞偑埑弅壜擻偱偁傞偲偄偆偙偲偼娤應偟偰偄傞懳徾偑崅師尦嬻娫傪帺桼偵摦偗傞傢偗偱側偔壗傜偐偺懡條懱忋偵惂尷偝傟偰偄傞偲峫偊傜傟傞丅椺偊偽庡惉暘暘愅偱偼挻暯柺忋偵惂尷偝傟偰偄傞応崌偵桳岠偱偁傞偟挻暯柺偵尷傜側偄懡條懱偵惂尷偝傟偨応崌偵桳岠偱偁傞ISOMAP傗僇乕僱儖庡惉暘暘愅側偳傕抦傜傟偰偄傞丅

丂偟偐偟偙傟傜偺庤朄偱偼僨乕僞偑懡條懱忋偱偳偺傛偆偵暘晍偟偰偄傞偐傪摼傞偙偲偼偱偒傞偑丄偦偺懡條懱偑崅師尦嬻娫拞偱偳偺傛偆側宍傪偟偰偄傞偐傪抦傞偙偲偼偱偒側偄丅傕偪傠傫庡惉暘暘愅偱偼挻暯柺傪挘傞婎掙儀僋僩儖傪摼傞偙偲偑偱偒傞偑ISOMAP傗僇乕僱儖庡惉暘暘愅側偳旕慄宍偵奼挘偡傟偽傢偐傜側偔側偭偰偟傑偆丅

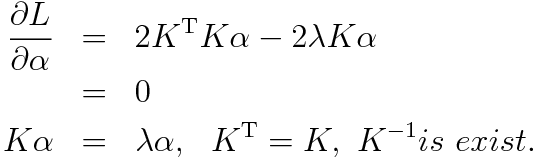

丂偦偙偱僨乕僞偑懡條懱忋偱偳偺傛偆偵暘晍偟偰偄傞偺偐偱偼側偔僨乕僞偑暘晍偟偰偄傞懡條懱偑偳偺傛偆側宍傪偟偰偄傞偺偐傪悇掕偡傞庤朄傪峫偊偰傒偨偄偲巚偆丅堦斒揑側懡條懱傪昞尰偡傞偙偲偼擄偟偄偺偱偙偙偱偼懡條懱偑堿娭悢偺宍偱掕媊偝傟偰偄傞偲壖掕偡傞丅偡側傢偪

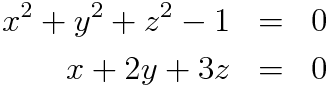

偲偄偆峆摍幃偵傛偭偰婰弎偝傟偰偄傞偲壖掕偡傞丅椺偊偽嶰師尦拞偵杽傔崬傑傟偰偄傞墌偼椺偊偽

偺傛偆側堿娭悢偵傛偭偰婰弎偝傟偰偄傞丅

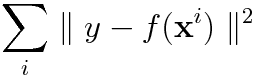

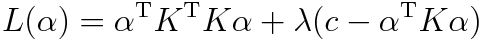

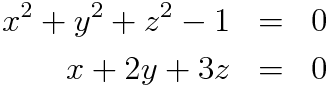

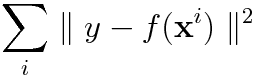

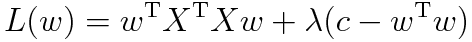

丂偱偼幚嵺偵僨乕僞廤崌偑梌偊傜傟偨偲偒偵偦傟偑杽傔崬傑傟偰偄傞懡條懱傪婰弎偡傞堿娭悢傪媮傔傞庤朄傪峫偊偰傒傛偆丅堦斒偵娭悢傪悇掕偡傞摑寁揑榞慻傒偲偟偰夞婣暘愅偲偄偆傕偺偑抦傜傟偰偄傞丅椺偊偽娭悢偵慄宍惈傪壖掕偡傟偽慄宍夞婣丄旕慄宍偵奼挘偟偨応崌偵偼僇乕僱儖夞婣偲偄偆傕偺偑偁傞丅堿娭悢偺悇掕偵偮偄偰傕夞婣暘愅偵偍偗傞栚揑曄悢傪偡傋偰侽偲偍偄偨応崌偲峫偊傞偙偲偑偱偒傞丅偮傑傝夞婣暘愅偵偍偄偰偼埲壓偺傛偆側擇忔岆嵎傪嵟彫偵偡傞傛偆側幨憸傪媮傔傞偙偲傪峫偊傞偑

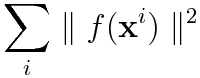

堿娭悢偺悇掕傪峫偊傞偲偙偺栚揑曄悢傪侽偲抲偔偙偲偱

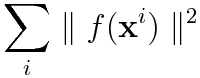

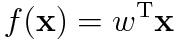

傪嵟彫壔偡傞偲偄偆栤戣偵婣拝偱偒傞偙偲偑傢偐傞丅埲壓偱偼娭悢偑慄宍傪枮偨偡応崌傪峫偊傞丅偡側傢偪

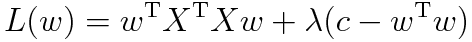

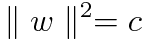

偲偐偗傞応崌傪峫偊傞丅偙偙偱偙偺昡壙娭悢傪嵟彫偵偡傞傛偆側帺柧側夝偼傕偪傠傫w=0偱偁傞偑偙傟傪彍奜偡傞偨傔偵

偲抲偔偲乮c 偼掕悢乯儔僌儔儞僕儏偺枹掕忔悢朄偵傛傝儔僌儔儞僕儏娭悢偼

偲偐偗偦偺嬌抣偼

偲偄偆屌桳抣栤戣偵傛傝媮傑傞丅偡側傢偪屌桳抣兩傪嵟彫乮傕偟偔偼侽乯偵偡傞傛偆側屌桳儀僋僩儖倵偑媮傔傞幨憸偵懳墳偡傞偺偩丅

丂幚偼偙傟偼庡惉暘暘愅偲慡偔摨偠寁嶼傪偟偰偄傞偙偲偵側傞丅庡惉暘暘愅偼忋婰偺屌桳抣栤戣偵偍偄偰屌桳抣兩傪嵟戝偵偡傞傛偆側屌桳儀僋僩儖倵偵傛偭偰僨乕僞傪掅師尦嬻娫偵幩塭偡傞庤朄偱偁偭偨丅堿娭悢悇掕偵傛偭偰媮傑傞倵偼偙傟傜偺儀僋僩儖偲捈峴偟偰偄傞丄偡側傢偪僨乕僞偑懚嵼偡傞挻暯柺偺朄慄儀僋僩儖偵懳墳偟偰偄傞偲尵偊傞丅偄傑傑偱庡惉暘暘愅傪偟偰偄偨嵺偵巊傢偢偵幪偰偰偄偨彫偝偄屌桳抣偵懳墳偡傞屌桳儀僋僩儖偼幚偼堿娭悢悇掕偵懳墳偟偰偄偨偺偩丅堿娭悢悇掕偼傑偝偵庡惉暘暘愅偺儂儖儌儞偱偁傞丅

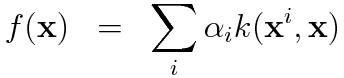

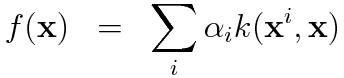

丂師偵幨憸傪旕慄宍幨憸偵傑偱奼挘偟傛偆丅嬶懱揑偵偼僇乕僱儖夞婣暘愅傪梡偄傞丅偙偺帪幨憸偼

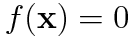

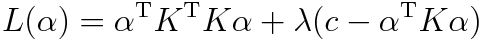

偺傛偆偵偐偗慄宍偺応崌偲摨偠棟桼偵傛傝學悢偑侽偱側偄偲偄偆惂尷傪愝偗傞偲擇忔岆嵎傪嵟彫偵偡傞傛偆側學悢偼儔僌儔儞僕儏偺枹掕忔悢朄偵傛傝媮傔傞偙偲偑偱偒丄儔僌儔儞僕儏娭悢偼

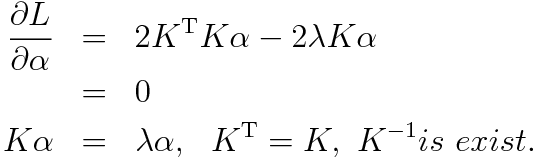

偲側傝乮偨偩偟K偼僌儔儉峴楍乯偦偺嬌抣偼

偲偄偆屌桳抣栤戣傪夝偔偙偲偵傛傝摼傜傟傞丅偙傟傕僇乕僱儖庡惉暘暘愅偲慡偔偍側偠偵側偭偰偍傝彫偝偄屌桳抣偵懳墳偡傞屌桳儀僋僩儖偑堿娭悢悇掕偺寢壥丄戝偒偄屌桳抣偵懳墳偡傞屌桳儀僋僩儖偑僇乕僱儖庡惉暘暘愅偵懳墳偡傞寢壥偲側偭偰偄傞丅

丂埲忋偵傒傞傛偆偵崅師尦嬻娫拞偵杽傔崬傑傟偨懡條懱傪婰弎偡傞堿娭悢傪悇掕偡傞庤朄傪峫偊傞偲夞婣暘愅傪捠偟偰庡惉暘暘愅丒僇乕僱儖庡惉暘暘愅偲懳墳偟偰偄傞偙偲偑傢偐偭偨丅

偞偭偲